| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | ||||||

| 2 | 3 | 4 | 5 | 6 | 7 | 8 |

| 9 | 10 | 11 | 12 | 13 | 14 | 15 |

| 16 | 17 | 18 | 19 | 20 | 21 | 22 |

| 23 | 24 | 25 | 26 | 27 | 28 | 29 |

| 30 |

- 스터디

- WHS

- 자라나는새싹

- CSRF

- WarGame

- dreamhack

- 인프런

- XSS

- BaekJoon

- 웹해킹

- hacking

- 자라나는 새싹

- 디지털 포렌식

- C언어

- Algorithm

- 워게임

- 문제풀이

- webhacking.kr

- 백준

- command

- c

- 드림핵

- 풀이

- 프로그래머스

- Programmers

- 알고리즘

- Web

- 포렌식

- 파이썬

- Python

- Today

- Total

Hoin's security

[논문분석] 슬라이딩 윈도우 기반BERT를활용한AWSCloudTrail MITRE ATT&CK공격탐지 본문

0. 논문 선정 이유

AWS에 관심이 생겨 공부하던 중 보안과 연관지어 진행된 연구가 있을까 했는데 마침 올해 작성된 연구 논문이 있어 해당 논문을 선택하였다. 기존의 CloudTrail과 차이점이 무엇이고 이점이 되는 부분이 어떤 것인지 알고 싶어졌다. 또한 AI를 활용한(BERT) 내용이라 보안과 AI를 어떻게 잘 결합했고 활용했는지 궁금해졌다.

1. 서론

클라우드 환경의 확산으로 인해 복잡한 인프라 내에서 잠재적인 보안 위협을 식별하는 것은 필수적 과제이다.

AWS CloudTrail 로그는 사용자의 API 호출, 리소스 접근, 권한 변경 등의 이벤트를 상세히 기록하기 때문에 위협 탐지와 행위 분석에 활용해야 한다.

기존의 규칙 기반 또는 머신러닝 기반 로그 분석 기법은 한계가 있다.

-> 로그의 시계열적 특성과 문맥적 관계를 충분히 반영하지 못하기 때문에 지능형 지속 위협(APT)과 같은 복합 공격을 탐지하기 어렵다는 문제.

최근 RNN, LSTM, GRU 기반의 딥러닝 모델이 로그 시퀀스 분석에 활용되고 있으나 이들 모델은 데이터의 단방향 처리 특성으로 인해 양방향 문맥 정보를 학습하기 어렵다. + 또한 긴 시퀀스 데이터를 병렬로 처리하기 어렵다는 제약이 존재한다.

따라서 본 연구에서는 BERT 모델의 Self-Attention 구조와 슬라이딩 윈도우 기법을 결합한 모델을 제안하고 있다.

이 모델은 AWS CloudTrail 로그의 시계열적 연속성과 문맥 정보를 동시에 학습하여 MITRE ATT&CK 프레임워크의 전술(Tactic) 및 기법(Technique)을 자동으로 예측한다.

2. 관련 연구

- 기존 접근법: 초기에는 규칙 기반 시스템과 키워드 매칭 방식이 사용되었으나, 이는 정의된 패턴에만 효과적이며 복잡한 상관관계 탐지에 한계가 있다. 이후 PCA 나 OC-SVM 같은 머신러닝 비지도 학습이 활용되었지만, 로그 데이터의 시계열적 의존성을 학습하지 못하는 한계가 존재한다.

- 딥러닝 기반 모델: DeepLog , LogAnomaly 등 RNN 기반 모델은 로그의 단기 의존성을 학습하는 데 효과적이었다. LogLS는 이중 LSTM 구조로 긴 로그 시퀀스의 예측 성능을 개선하기도 했다. 하지만 RNN은 이벤트 간 단방향 의존성만 학습하며 , 긴 시퀀스 처리나 병렬화에 어려움이 있다.

- 트랜스포머 기반 모델: BERT는 Self-Attention을 통해 양방향 문맥 정보 학습에 뛰어난 성능을 보인다. LogBERT는 BERT를 활용해 로그의 문맥 관계를 학습하고 이상 탐지에 성공했으나 , 긴 시퀀스 처리의 비효율성과 시계열적 특성을 명시적으로 반영하지 못하는 한계를 보였다.

본 연구는 이러한 기존 연구의 한계를 보완하기 위해 슬라이딩 윈도우 기법을 도입하여 긴 시퀀스 처리의 비효율성과 문맥 정보 학습의 제한을 해결하고자 한다.

3. 학습 데이터 구축 및 데이터 전처리

- 로그 데이터 처리: AWS CloudTrail 로그의 여러 필드 중, 오픈소스 공격 도구(Offensive Tool)에서 제공하는 공격 시나리오를 기반으로 분석 대상을 선정했다. 특히 권한 상승(Privilege Escalation) 시나리오 탐지에 효과적인 필드를 설계했으며 이는 IAM 관련 위협이 클라우드 보안의 주요 문제임을 반영한다. 학습에 사용된 주요 필드는 Table 1에 명시되어 있으며 userIdentity, accessKeyId, eventName, eventTime, errorCode 등이 포함된다.

- 학습 데이터 구축: 현실적인 공격 시나리오 확보를 위해 Stratus Red Team , Pacu , CloudGoat 등 3가지 오픈소스 보안 도구를 활용하여 AWS 환경에서 공격을 시뮬레이션하고 로그 데이터를 생성했다.

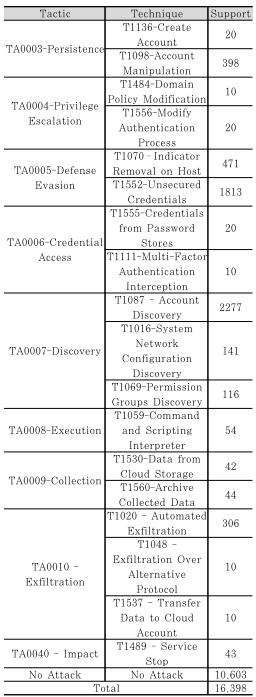

- 라벨링: TrailDiscover 데이터셋을 활용하여 수집된 AWS CloudTrail 로그(특히 eventName )를 MITRE ATT&CK 전술 및 기법과 매핑하여 라벨링을 진행했다. 학습에 사용된 주요 공격 기법과 데이터 분포는 Table 2에 정리되어 있다.

4. 제안 기법

본 연구는 슬라이딩 윈도우 기반 BERT 모델을 활용하여 CloudTrail 로그를 분석하고 MITRE ATT&CK 전술 및 기법을 예측한다.

- 프레임워크 구조: 전처리된 AWS CloudTrail 로그(JSON 형식) 에 슬라이딩 윈도우 기법을 적용하여 고정된 크기(W=5)의 로그 시퀀스를 생성한다. 이는 로그 데이터 내 문맥적, 시계열적 정보를 유지하며 학습 효율성을 높인다.

- 슬라이딩 윈도우 기법 (Fig. 1): 긴 로그 시퀀스를 고정된 크기(Window size W=5 )의 작은 단위로 분할한다. Stride는 S=1로 설정하여 윈도우 간 데이터가 겹치도록 설계했다. 이는 시계열적 연속성을 보장하고 정보 손실을 최소화하며 국소적 문맥 정보를 효과적으로 학습하고 연산 부담을 줄인다.

- BERT 모델 (Fig. 1): 윈도우로 생성된 로그 시퀀스를 BERT 모델의 입력으로 사용한다. BERT의 Self-Attention 메커니즘은 입력 데이터(로그 이벤트)의 문맥적 정보를 학습한다. 본 연구에서는 Token Classification을 활용하여 윈도우 안의 각각의 로그 데이터(토큰)를 분석하고 각 로그에 해당하는 MITRE ATT&CK 전술 및 기법을 예측(분류)한다.

5. 성능 검증

- 실험 설정:

- 평가 지표: 정밀도(Precision), 재현율(Recall), F1 점수(F1 Score)를 기준으로 모델 성능을 평가했다.

- 데이터셋: 슬라이딩 윈도우 (W=5, S=1)를 적용한 로그 데이터를 Stratified Sampling을 통해 Train:Validation:Test = 7:1.5:1.5 비율로 분리했다.

- 모델 및 하이퍼파라미터: Pre-trained bert-base-uncased 기반 BertForTokenClassification 모델을 사용했다. 클래스 불균형 문제를 완화하기 위해 가중치가 적용된 nn.CrossEntropyLoss를 손실함수로 사용했으며 , AdamW 옵티마이저 , learning rate 5e-5, batch size 1, epoch 6으로 학습했다. 과적합 방지를 위해 Early Stopping(patience=3)을 적용했다.

- 실험 결과:

- 전체 성능 (Table 3): 제안 모델은 Weighted Average F1 Score 0.933 (Precision 0.941, Recall 0.932)의 우수한 성능을 보였다.

- Baseline 비교:

- Baseline 1 (특징 선택 X, 슬라이딩 윈도우 X): F1 Score 0.624 (Table 4). 과도하게 많은 로그 필드로 인해 불필요한 정보가 포함되어 중요한 정보에 Attention하지 못한 것으로 해석된다.

- Baseline 2 (특징 선택 O, 슬라이딩 윈도우 X): F1 Score 0.841 (Table 5). 이는 윈도우 크기 W=1과 동일하며 , 시계열적 맥락 정보를 반영하지 못해 로그 간 상관관계 학습이 제한된 것으로 판단된다.

- 윈도우 크기별 성능 (Table 7, Fig. 2): 윈도우 크기(W)를 1, 3, 5, 7로 변경하며 실험했다. W=1(Baseline 2)일 때 F1 0.841, W=3일 때 F1 0.915, W=5일 때 F1 0.933으로 가장 높은 성능을 기록했다. 윈도우 크기가 7로 증가하자 성능이 F1 0.905로 다시 하락했는데 이는 윈도우가 실제 공격 로그 시퀀스 길이보다 길어져 이상 행위와 연관 없는 이벤트까지 학습 대상이 되어 오탐률이 증가한 것으로 분석된다.

- 기법별 성능 분석 (Table 6):

- 대부분 좋은 성능을 보였으나 T1555, T1016, T1530, T1020 등 일부 기법에서 상대적으로 낮은 성능이 관찰되었다.

- T1555 (Credentials from Password Stores): Precision이 0.27로 낮았는데 , 이는 학습 데이터 수(Support=3)가 매우 적고 다른 Credential Access 관련 기술과 이벤트 패턴이 유사하여 혼동되었기 때문이다.

- T1016 (System Network Configuration Discovery): Precision이 0.59로 낮았으며 , 이는 유사한 eventName을 가진 T1087 (Account Discovery)로 오분류되었기 때문이다.

- T1020 (Automated Exfiltration): Precision(0.61)과 Recall(0.97) 간의 차이가 컸는데 , 이는 모델이 공격(Attack)과 정상(No Attack)은 잘 구분했으나 , 유사한 다른 Exfiltration 기법(T1048)과의 세부적인 구분에서 혼동이 발생했기 때문이다.

- 이러한 개별 클래스 간 성능 저하는 주로 클래스별 데이터 불균형이 원인일 가능성이 높다.

6. 결론

본 연구는 AWS CloudTrail 로그 분석을 위해 슬라이딩 윈도우 기반 BERT 모델을 제안했다. 이 접근법은 긴 로그 시퀀스를 작은 윈도우로 분할하여 문맥 정보를 세밀하게 학습하고 이벤트 간 연관성을 효과적으로 반영하도록 설계되었다.

실험 결과, 제안 모델은 F1 Score 0.933을 기록하며 MITRE ATT&CK 기술에 대해 높은 탐지 성능을 입증했다. 이는 로그 분석에서 문맥 정보 활용의 중요성을 보여주며, 제안 모델이 효율적이고 신뢰할 수 있는 위협 탐지 시스템으로 확장될 가능성을 시사한다.

다만, 본 연구는 확보된 데이터셋이 모든 MITRE ATT&CK 전술 및 기법을 포괄하지 못했고, 제한된 라벨 값으로 실험을 진행한 한계가 있다. 향후 연구에서는 데이터셋을 확장하여 더 다양한 전술과 기법을 다루고, 데이터 불균형 문제를 해결하며, 실시간 탐지 능력을 강화하는 방향으로 발전할 수 있을 것이다.

7. 배운점 및 느낀점

공격은 로그 1개가 아니라 여러 개의 로그가 이어져서 발생하므로 로그간의 상관관계(슬라이딩 윈도우, BERT)를 파악하는 것이 중요하다는걸 알았다. 또한 로그를 많이 학습시키면 더 좋을 줄 알았는데 그게 아니라 공격 이벤트라고 판단 후 그 로그들만 학습시켜야 도움이 되므로 사람이 공격데이터를 판단하는 것이 중요하다고 생각했다.

'스터디 > 논문 분석' 카테고리의 다른 글

| [논문 분석] You Are How You Walk Quantifying Privacy Risksin Step Count Data (0) | 2025.11.12 |

|---|---|

| [논문분석] AI기반 사이버 공격그룹 인프라 추적 시스템 개발 (0) | 2025.10.01 |

| [논문 분석] 토르(Tor)와 익명으로 읽을 권리 - 홍은표논문 분석] 토르(Tor)와 익명으로 읽을 권리 - 홍은표 (0) | 2025.09.17 |

| [논문 분석] 다크웹 환경에서 산업기술 유출 탐지 시스템 (0) | 2024.05.30 |

| 논문분석 - 보안위협 모니터링을 위한 AI 데이터셋 구성방안 연구 (0) | 2024.05.15 |